La nuova guerra dell’Europa alla privacy – Chat Control violerà i diritti fondamentali

di TERMOMETRO GEOPOLITICO (Thomas Fazi)

In teoria, Chat Control avrebbe dovuto essere sepolto il mese scorso. Il minaccioso piano dell’UE di scansionare in massa i messaggi privati dei cittadini ha incontrato una schiacciante resistenza pubblica in Germania, con il governo del paese che si è rifiutato di approvarlo. Ma Bruxelles raramente si tira indietro solo perché i cittadini lo chiedono. E così, fedele alla sua forma, una versione rielaborata del testo è già in fase di elaborazione, questa volta nascosta, a porte chiuse.

Il Chat Control, formalmente noto come Regolamento sugli abusi sessuali sui minori, è stato proposto per la prima volta dalla Commissione Europea nel 2022. Il piano originale avrebbe reso obbligatorio per i provider di posta elettronica e messaggistica analizzare le comunicazioni private, anche crittografate, con il presunto obiettivo di rilevare materiale pedopornografico.

Lo strumento è stato venduto come una nobile crociata contro alcuni dei crimini più orribili al mondo. Ma i critici hanno sostenuto che rischiava di diventare un modello per una sorveglianza generalizzata, dando di fatto agli Stati e alle istituzioni dell’UE la possibilità di scansionare ogni messaggio privato. In effetti, una consultazione pubblica precedente la proposta ha rivelato che la maggioranza degli intervistati si opponeva a tali obblighi, con oltre l’80% che ne respingeva esplicitamente l’applicazione alle comunicazioni crittografate end-to-end.

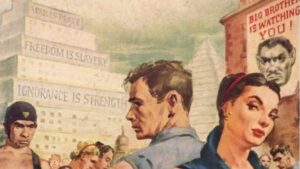

Eppure, nonostante i ripetuti blocchi e le diffuse critiche per la violazione della privacy e dei diritti fondamentali, il testo non è mai stato abbandonato. Anzi, è stato riconfezionato e continuamente portato avanti da una presidenza del Consiglio all’altra. Ogni volta che la resistenza democratica ha bloccato il piano originale, questo ha continuato a ripresentarsi in nuove forme, con nuove etichette, ogni volta spacciato per uno strumento “necessario” e “urgente” per proteggere i minori online, pur preservando sempre la sua logica fondamentale: normalizzare il monitoraggio governativo delle comunicazioni private su una scala senza precedenti.

A maggio, la Commissione europea ha nuovamente presentato la sua proposta. Tuttavia, diversi Stati si sono opposti. Tra questi, la Germania, ma anche Polonia, Austria e Paesi Bassi. Di conseguenza, la Danimarca, che attualmente detiene la presidenza di turno del Consiglio europeo, ha immediatamente avviato la stesura di una nuova versione, nota come “Chat Control 2.0” e presentata all’inizio di questo mese, che ha eliminato l’obbligo di monitoraggio generale delle chat private; le ricerche rimarrebbero ora formalmente volontarie per i provider. Tutto ciò è avvenuto sotto l’egida del Coreper, il Comitato dei rappresentanti permanenti, una delle istituzioni più potenti, ma meno visibili, nel processo decisionale dell’UE. È qui che viene effettivamente negoziata la maggior parte della legislazione dell’UE; se il Coreper approva un fascicolo legislativo, gli Stati membri quasi sempre lo approvano automaticamente.

La scommessa ha funzionato. Ieri, questa versione rivista ha ricevuto il via libera del Coreper, aprendo di fatto la strada all’adozione del testo da parte del Consiglio, probabilmente già a dicembre. Come ha affermato Patrick Breyer, attivista per i diritti digitali ed ex eurodeputato , questa manovra equivale a “un ingannevole gioco di prestigio” volto a eludere un dibattito democratico significativo e la supervisione.

Sebbene l’eliminazione del rilevamento obbligatorio sui dispositivi rappresenti un miglioramento rispetto alla prima bozza, il nuovo testo contiene ancora due aspetti estremamente problematici. In primo luogo, incoraggia la scansione di massa “volontaria” da parte delle piattaforme online, una pratica già consentita in forma “temporanea”, che ora diventerebbe una caratteristica duratura del diritto dell’UE. In secondo luogo, vieta di fatto la comunicazione anonima introducendo sistemi obbligatori di verifica dell’età.

Una lettera aperta firmata da 18 dei principali accademici europei in materia di sicurezza informatica e privacy ha avvertito che l’ultima proposta comporta “elevati rischi per la società senza chiari benefici per i minori”. Il primo, a loro avviso, è l’espansione della scansione “volontaria”, inclusa l’analisi automatizzata del testo tramite intelligenza artificiale per identificare comportamenti ambigui di “adescamento”. Questo approccio, sostengono, è profondamente imperfetto. Gli attuali sistemi di intelligenza artificiale non sono in grado di distinguere correttamente tra conversazioni innocenti e comportamenti abusivi. Come spiegano gli esperti, il rilevamento del “grooming” basato sull’intelligenza artificiale rischia di travolgere un gran numero di normali conversazioni private, sommergendo gli investigatori con falsi positivi ed esponendo comunicazioni intime a terze parti.

Breyer ha ulteriormente sottolineato questo pericolo osservando che nessuna IA è in grado di distinguere in modo affidabile tra un flirt innocente, un sarcasmo umoristico e un adescamento criminale. Ha avvertito che questo equivale a una forma di caccia alle streghe digitale, in cui la semplice comparsa di parole come “amore” o “incontro” in una conversazione tra familiari, partner o amici potrebbe innescare un controllo invasivo. Non si tratta di protezione dei minori, ha sostenuto Breyer, ma di un sospetto di massa rivolto all’intera popolazione. Anche con l’attuale regime volontario, la polizia federale tedesca avverte che circa la metà di tutte le segnalazioni ricevute sono penalmente irrilevanti, il che rappresenta decine di migliaia di chat legali trapelate ogni anno. Secondo la Polizia federale svizzera, nel frattempo, l’80% dei contenuti segnalati dalle macchine non è illegale. Potrebbero, ad esempio, comprendere foto innocue di vacanze che mostrano bambini nudi che giocano in spiaggia. Il nuovo testo amplierebbe drasticamente questi rischi.

Ulteriori preoccupazioni derivano dall’articolo 4 della nuova proposta di compromesso, che impone ai provider di implementare “tutte le misure appropriate di mitigazione del rischio”. Questa clausola potrebbe consentire alle autorità di esercitare pressioni sui servizi di messaggistica crittografata affinché consentano la scansione, anche se ciò compromette il loro modello di sicurezza fondamentale. In pratica, ciò potrebbe significare richiedere a provider come WhatsApp, Signal o Telegram di scansionare i messaggi sui dispositivi degli utenti prima di applicare la crittografia.

L’Electronic Frontier Foundation ha osservato che questo approccio rischia di creare un’infrastruttura di sicurezza permanente, che potrebbe gradualmente diventare universale. Meta, Google e Microsoft già analizzano volontariamente i contenuti non crittografati; estendere questa pratica ai contenuti crittografati richiederebbe semplicemente modifiche tecniche. Inoltre, quella che inizia come un’opzione volontaria può facilmente diventare obbligatoria nella pratica, poiché le piattaforme subiscono pressioni reputazionali, legali e di mercato per “collaborare” con le autorità. Inoltre, questo non riguarda solo i cittadini dell’UE, ma tutti nel mondo, compresi gli Stati Uniti. Se le piattaforme decidessero di rimanere nell’UE, sarebbero costrette a analizzare le conversazioni di tutti i cittadini del blocco. Se non sei nell’UE, ma chatti con qualcuno che lo è, anche la tua privacy è compromessa.

Un altro grave pericolo è l’introduzione di sistemi obbligatori di verifica dell’età per gli app store e i servizi di messaggistica privata. Sebbene il Consiglio affermi che questi sistemi possano essere progettati per “preservare la privacy”, i critici insistono sul fatto che il concetto stesso sia tecnologicamente impraticabile. Le valutazioni dell’età si basano inevitabilmente su dati biometrici e comportamentali, entrambi i quali richiedono una raccolta di dati invasiva. Lungi dal proteggere i minori, questi sistemi aumenterebbero il volume di informazioni personali sensibili archiviate e potenzialmente sfruttate.

Richiedere documenti d’identità ufficiali per la verifica online escluderebbe milioni di persone che non hanno facile accesso a documenti d’identità digitali o che non sono disposte a fornire una documentazione così sensibile solo per utilizzare un servizio di messaggistica. In pratica, ciò significherebbe la fine della comunicazione anonima online, costringendo gli utenti a presentare un documento d’identità o una scansione del volto semplicemente per aprire un account di posta elettronica o di messaggistica. Breyer ha avvertito che tali misure sarebbero particolarmente disastrose per informatori, giornalisti, attivisti politici e altri soggetti che fanno affidamento sull’anonimato online. Inoltre, spingerebbe i minori di 16 anni verso alternative meno sicure e scarsamente regolamentate, prive di crittografia o di protezioni di sicurezza di base.

In definitiva, i critici sostengono che la sorveglianza di massa sia semplicemente l’approccio sbagliato per combattere lo sfruttamento sessuale dei minori. La scansione dei messaggi privati non blocca la circolazione di materiale pedopornografico. Piattaforme come Facebook utilizzano tecnologie di scansione da anni, eppure il numero di segnalazioni automatiche continua ad aumentare. Inoltre, la scansione obbligatoria non riuscirebbe comunque a individuare i responsabili che distribuiscono materiale attraverso forum segreti decentralizzati o archivi crittografati condivisi utilizzando solo link e password, metodi che gli algoritmi di scansione non riescono a penetrare con successo. La strategia più efficace sarebbe quella di eliminare il materiale pedopornografico noto dagli host online, cosa che l’Europol ha ripetutamente omesso di fare.

In breve, il Controllo delle Chat farebbe ben poco per aiutare effettivamente le vittime di sfruttamento sessuale minorile, danneggiando al contempo tutti gli altri. Ogni messaggio diventerebbe soggetto a sorveglianza, senza alcun controllo giudiziario, in contrasto con le consolidate garanzie di corrispondenza privata. Anche qui sorge una questione giuridica. La Corte di Giustizia dell’UE ha già stabilito che l’analisi generale e automatica delle comunicazioni private viola i diritti fondamentali, eppure l’UE è ora pronta ad adottare una legislazione che viola questo precedente. Una volta adottata, potrebbero volerci anni prima che un nuovo ricorso giudiziario la annulli.

La riservatezza delle comunicazioni elettroniche, essenziale per la privacy personale, il segreto aziendale e la partecipazione democratica, verrebbe sacrificata. Conversazioni sensibili potrebbero essere lette, analizzate, segnalate erroneamente o persino utilizzate in modo improprio, come hanno dimostrato gli scandali passati che hanno coinvolto funzionari dell’intelligence e dipendenti del settore tecnologico. Uno dei casi più noti di abuso di intelligence è quello della National Security Agency statunitense, in cui diversi dipendenti della NSA sono stati sorpresi a utilizzare i potenti strumenti di sorveglianza dell’agenzia per spiare partner ed ex amanti. Documenti trapelati hanno anche dimostrato che l’agenzia di intelligence britannica GCHQ ha catturato e archiviato immagini dalle chat delle webcam di Yahoo, tra cui milioni di immagini sessualmente esplicite di utenti completamente innocenti. Ci sono stati anche diversi casi in cui dipendenti di Big Tech, da Google a Facebook , hanno utilizzato strumenti interni per spiare utenti ignari.

Inoltre, la crittografia sicura, fondamento della sicurezza informatica, verrebbe compromessa dall’introduzione di backdoor o strumenti di scansione lato client che i servizi segreti stranieri o i criminali potrebbero sfruttare. Allo stesso tempo, la responsabilità delle indagini penali passerebbe dalle autorità democraticamente responsabili ad algoritmi aziendali poco trasparenti, con trasparenza e controllo minimi.

Gli oppositori sostengono pertanto che l’UE dovrebbe invece adottare un approccio fondamentalmente diverso: che protegga i minori senza compromettere i diritti fondamentali. Propongono di porre fine all’attuale scansione volontaria dei messaggi privati da parte delle aziende Internet statunitensi – ripristinando il principio secondo cui la sorveglianza mirata richiede un mandato giudiziario e deve essere limitata a individui ragionevolmente sospettati di illeciti – e sostengono che la crittografia end-to-end sicura e il diritto all’anonimato debbano essere preservati.

Particolarmente preoccupante è il problema del “function creep”, il processo attraverso il quale una tecnologia introdotta per uno scopo strettamente definito si espande gradualmente nel tempo per servire scopi più ampi, e talvolta completamente diversi. L’Online Safety Act del Regno Unito, approvato nell’ottobre 2023, obbliga le aziende a sviluppare sistemi di rilevamento degli abusi sessuali su minori, sebbene lo stesso governo britannico ammetta che tale infrastruttura non sia ancora tecnicamente disponibile, creando un’autorità legale in attesa di capacità tecnica. Negli Stati Uniti, le misure di sorveglianza “temporanee” introdotte dal Patriot Act post-11 settembre sono diventate permanenti e, di fatto, hanno ampliato la loro portata. Una volta che esiste un’infrastruttura tecnologica per una sorveglianza online completa, può essere facilmente riadattata ed è difficile da smantellare. Le tecnologie progettate per rilevare contenuti dannosi possono essere rapidamente estese alla repressione politica; esempi di stati autoritari dimostrano come sistemi simili vengano utilizzati per identificare e prendere di mira i dissidenti.

Breyer ha riassunto questo schema in modo netto: “Ci stanno vendendo sicurezza, ma ci consegnano una macchina di sorveglianza totale. Promettono protezione per i minori, ma puniscono i nostri figli e criminalizzano la privacy”. Le implicazioni sono inquietanti. L’Europa è di fatto sul punto di costruire una macchina in grado di vedere tutto. Una volta costruita, servirà non solo le attuali autorità politiche – l’idea che Ursula von der Leyen spii i messaggi di tutti è già abbastanza inquietante – ma chiunque eserciti il potere in futuro. Con l’avvicinarsi di un altro voto, la finestra per fermare il Controllo delle Chat si sta restringendo.

#TGP #UE #Europa #ChatControl

Fonte: https://unherd.com/2025/11/europes-new-war-on-privacy/

Fonte: https://www.facebook.com/share/17e6a1aPvU/

Commenti recenti