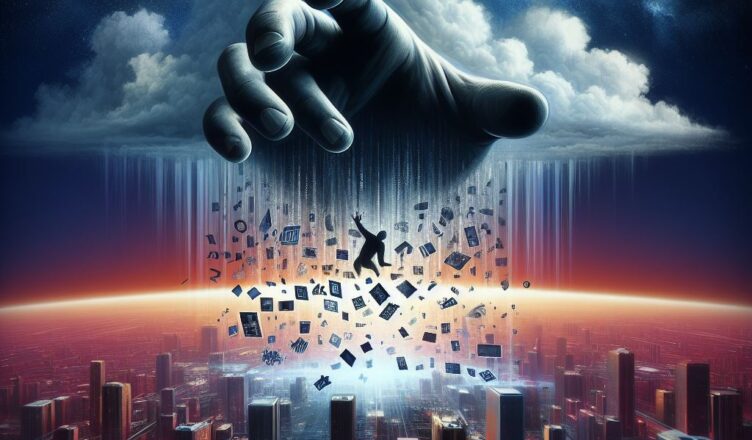

In un mondo sempre più interconnesso digitalmente, la libertà di espressione online è diventata un tema di crescente preoccupazione. Con l’avanzare dei progetti come Hatedemics, finanziato dall’Unione Europea, l’uso dell’intelligenza artificiale per monitorare e manipolare i contenuti sui social media sta diventando sempre più diffuso. In un articolo molto interessante il grande giornalista e saggista tedesco Norbert Haering ci spiega cosa si nasconde dietro a questa iniziativa e quali implicazioni potrebbe avere per la libertà di informazione e opinione

Con il pretesto di promuovere l’impegno “civico”, la Commissione europea sta finanziando lo sviluppo di software di intelligenza artificiale per analizzare e manipolare i social media. Questi strumenti sono destinati ad essere utilizzati da organismi di controllo statali e privati, nonché da agenzie governative. Il lavoro preparatorio è stato svolto negli Stati Uniti. In caso di “crisi”, si potranno quindi tirare fuori tutti gli strumenti.

Il fatto che il governo tedesco sostenga finanziariamente organizzazioni private che indagano sui social media e segnalano la cosiddetta “disinformazione” e i “discorsi d’odio” alle forze dell’ordine o ai censori delle piattaforme è già oggetto di discussione critica. Lo stesso sta accadendo anche a livello europeo. La Commissione europea sta addirittura facendo sviluppare strumenti digitali per i fact-checkers e gli altri organismi di controllo, al fine di monitorare in modo esaustivo i social media. Chiunque si imbatta nel sito web Hatedemics.euha scoperto la punta di un enorme iceberg di influenza e censura sistematica dello spazio digitale da parte di chi detiene il potere (io mi sono imbattuto in un articolo su Apollo News).

Hatedemics è un progetto finanziato dall’UE con un milione di euro per sviluppare un software (“intelligenza artificiale”) per analizzare lo spazio digitale alla ricerca di opinioni e attività di opposizione. L’intelligenza artificiale ha anche lo scopo di aiutare la formulazione e la diffusione di contro-narrazioni.

Sotto la guida del centro di ricerca italiano sull’intelligenza artificiale Fondazione Bruno Kessler, un consorzio di 13 partner si è aggiudicato il contratto per lo sviluppo del software. Tra questi c’è l’azienda di sicurezza estone Saher, attiva a livello globale nel settore dell’antiterrorismo. Altri partner includono le società di fact-checking filogovernative FACTA e Pagella Politica, che operano principalmente con finanziamenti dell’UE. Queste società sono state obbligate dall’UE a svolgere il ruolo di censori di contenuti con un codice di condotta contro la disinformazione. Il consorzio comprende anche altri fact-checkers di vari Paesi, oltre a organizzazioni civili che si occupano di diversità e uguaglianza, nonché istituzioni pubbliche.

Hatedemics fa parte del programma da 16 milioni di euro “Cittadini, uguaglianza, diritti e valori” (CERV), finanziato dalla Commissione europea per sensibilizzare al rafforzamento delle capacità e all’attuazione della Carta dei diritti fondamentali dell’Unione europea.

Resta da scoprire a chi vadano gli altri 15 milioni della serie di programmi. Chiunque abbia conoscenze sulla giungla dei finanziamenti dell’UE può fornire informazioni pertinenti.

Partenariato pubblico-privato per la censura

L’invito a presentare proposte in lingua tedesca del programma CERV dell’UE afferma che:

“Affrontare gli hate speech attraverso una maggiore cooperazione tra la società civile e le autorità pubbliche e altre parti interessate è fondamentale per la protezione dei diritti fondamentali (libertà di espressione, dignità umana e non discriminazione) e per garantire democrazie sane e pluralistiche. (…) I progetti nell’ambito di questa priorità mirano a consentire alle organizzazioni della società civile di istituire meccanismi di cooperazione con le autorità per sostenere la denuncia dei crimini e dei discorsi d’odio, per garantire il sostegno alle vittime dei discorsi e dei crimini d’odio e per sostenere l’applicazione della legge, anche attraverso la formazione o i metodi e gli strumenti di raccolta dei dati. I progetti si concentreranno anche sulle misure per combattere i discorsi d’odio online, tra cui la segnalazione dei contenuti alle aziende informatiche, lo sviluppo di contro segnalazioni e campagne di sensibilizzazione, nonché misure educative per affrontare le sfide sociali dei discorsi d’odio online”.

Il progetto Hatedemics, che ha avuto successo con la sua candidatura, mira a utilizzare l’intelligenza artificiale per equipaggiare le organizzazioni della società civile e le agenzie governative nella lotta contro l’hate speech online.

Questo software viene utilizzato come sinonimo di teorie cospirative, odio, hate speech e disinformazione. Fornendo strumenti di intelligenza artificiale, le componenti della società civile saranno in grado di monitorare, individuare e segnalare i discorsi d’odio su Internet.

Il software creerà anche “contro-narrazioni basate sul dialogo” e misurerà automaticamente i cambiamenti di comportamento ottenuti grazie all’uso delle contro-narrazioni.

Gli sponsor del progetto promettono: “La combinazione di queste tecnologie consentirà interventi online più mirati e tempestivi”.

Mentore e pioniere USA

Un milione di euro non è certo sufficiente per sviluppare un programma di intelligenza artificiale come quello descritto. Ma quasi certamente non è neanche necessario. Dopotutto, c’è un pioniere che è sicuramente felice di mettere il suo lavoro preliminare a disposizione di una Commissione europea censoria, in modo che possa adattarlo alle condizioni e alle lingue locali. Come difficilmente potrebbe essere altrimenti, il lavoro preparatorio proviene dal Paese in cui hanno sede le principali piattaforme digitali la cui censura è in gioco.

La National Science Foundation (NSF), l’agenzia statunitense per il progresso della scienza, ha assegnato almeno 39 milioni di dollari a diversi team universitari e aziende per sviluppare l’intelligenza artificiale per la ricerca automatizzata e la censura dei media nello spazio digitale a partire dal 2021. È quanto emerge da un rapporto intermedio del 5 febbraio 2024 sulla National Science Foundation (NSF) redatto dalla Commissione investigativa del Congresso degli Stati Uniti sulle attività illegali di censura del governo.

Dalle e-mail e dalle presentazioni che la commissione ha potuto analizzare, è chiaro che le persone coinvolte erano consapevoli che si trattava di un programma di censura. Il rapporto mostra anche che la NSF ha nascosto attivamente il suo sostegno ai programmi in discussione.

I creatori di WiseDex, uno dei programmi di intelligenza artificiale finanziati, lo hanno elogiato come “un modo per i decisori delle piattaforme di esternalizzare il difficile compito della censura”.

Il programma Co-Inisghts, finanziato dalla NSF, dovrebbe avvicinarsi particolarmente a ciò che la Commissione europea si aspetta da Hatedemics. Secondo la descrizione, infatti, è in grado di filtrare i contributi per il fact-checking e di confrontare le dichiarazioni dei contributi con gli articoli di fact-check. Dovrebbe anche gestire canali automatizzati per gli informatori e convertire le informazioni in azioni di contrasto. In una presentazione, il team promette che Co-Insights può analizzare 750.000 articoli di blog e media al giorno e scansionare i dati di tutte le principali piattaforme di social media.

Il programma CourseCorrect, che “sostiene gli sforzi di giornalisti, sviluppatori e cittadini per verificare le informazioni delegittimanti”, ha un obiettivo simile.

Il compito del consorzio Hatedemics dovrebbe quindi essere solo quello di mettere insieme qualcosa di adatto all’UE multilingue da uno o più di questi programmi di censura.

Conclusione e analisi

L’UE fornisce un sostegno finanziario e tecnico su larga scala a organizzazioni della “società civile” solidali e a partenariati pubblico-privati per aiutarla a sopprimere opinioni inaccettabili su Internet o a contrastarle con contro-narrazioni. Ciò integra le varie iniziative dell’UE che obbligano le piattaforme digitali a bloccare o bloccare i contenuti inaccettabili.

Grazie al Digital Services Act (DSA) dell’UE, gli “interventi online mirati” che gli organizzatori del progetto Hatedemics promettono di rendere possibili possono arrivare a essere apertamente totalitari.

La legge consente di dichiarare “dannosi” e quindi soggetti a cancellazione i contenuti illegali. Dato che le piattaforme sono minacciate da sanzioni molto elevate, si assicura che la volontà di censurare sia alta e, in caso di dubbio, preferiscono cancellare e bloccare piuttosto che rischiare sanzioni.

In caso di “crisi”, i possibili “interventi online” che Hatedemics aiuta a preparare assumono una qualità ancora più drastica. A quel punto entra in gioco il “meccanismo di risposta alle crisi” del DSA (art. 36) e la Commissione UE può immediatamente richiedere alle aziende digitali misure radicali, come la manipolazione degli algoritmi di ricerca per rendere irrintracciabile tutto ciò che è sgradito o la demonetizzazione di tutti gli editori e pubblicisti sgraditi. Spetta alla Commissione UE decidere quali altre misure, oltre a quelle esemplificate nella legge, vuole proporre e cosa dichiarare come crisi.

È consigliabile costruire contatti e strutture più analogiche e non fare troppo affidamento sulla libertà in rapida diminuzione nello spazio digitale. I tecnocrati con ambizioni totalitarie possono monitorare lo spazio digitale in modo automatico e ravvicinato solo con l’aiuto di algoritmi

Commenti recenti